Niedawno odbyła się coroczna konferencja Apple. Firma z Cupertino, oprócz prezentacji nowych produktów, ogłasza na niej udostępnienie najnowszych systemów operacyjnych. Dlatego ja, jak co roku, już dziś zapraszam na podsumowanie nowości dostępnościowych w mobilnym systemie iOS. Postaram się Wam przybliżyć , zarówno te nowości, którymi chwali się firma Apple, jak i te po cichu wprowadzane do naszych iPhone’óww i iPad’ów. Zapraszam do lektury.

VoiceOver

Mowa

Klasycznie zaczynamy od nowości, które trafiły do czytnika ekranu VoiceOver. Pierwsze z nich znajdziemy w zakładce Mowa zlokalizowanej w głównych ustawieniach czytnika.

Apple regularnie dodaje nowe głosy do obsługi systemów operacyjnych. Od wersji iOS 26 VoiceOver zaczął mówić w języku bengalskim, gudżarackim, hindi, marathijskim i pendżabskim. Dla Polaków to niewielkie pocieszenie. Lecz dla osób, które się nimi posługują na co dzień, lub osób uczących się któregoś z tych języków, jest to interesująca informacja.

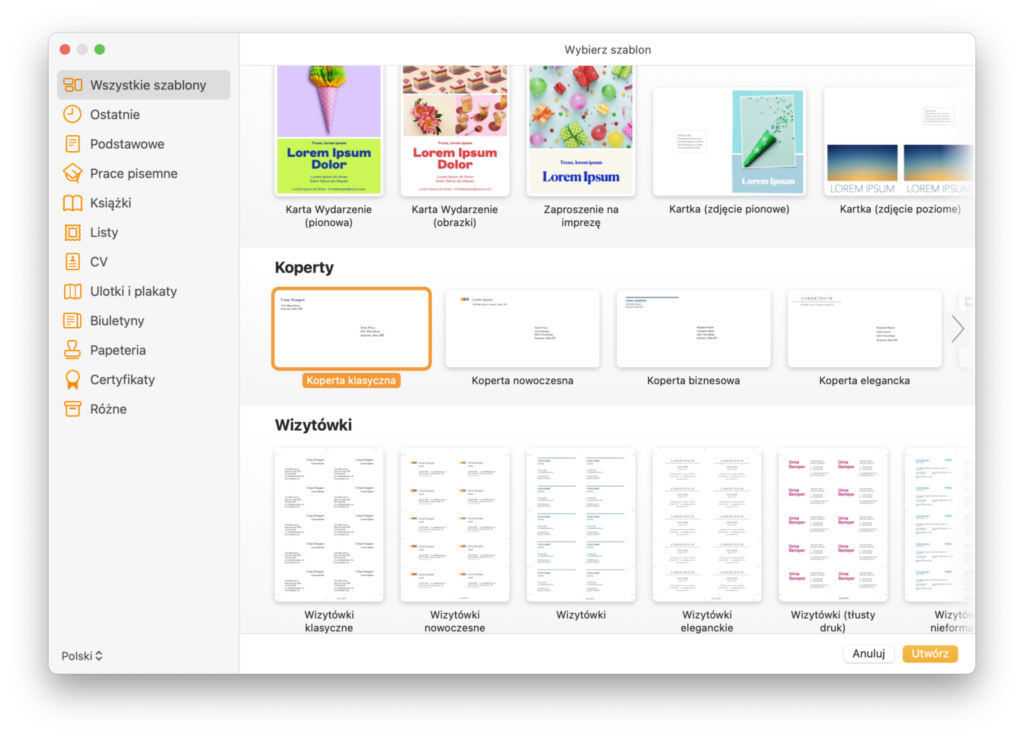

Pismo Braille’a

Za to w zakładce Pismo Braille’a pojawił się istny wysyp nowości. Jest ich tyle, że aż się boję, że któraś mi umknęła.

Pierwszą jest opcja Dostęp brajlowski. Umożliwia szybkie tworzenie i odczytywanie notatek brajlowskich, w tym z plików w formacie brajlowskiego zapisu BRF. Co ciekawe, pliki tworzone w ten sposób mogą być zapisywane i synchronizowane przez iCloud. Dodatkowo Dostęp brajlowski umożliwia teraz korzystanie z kalkulatora i odczytu Napisów na żywo.

Przegląd rzeczy to druga z nowości. Umożliwia odczyt kilku pierwszych komórek wielu rzeczy w tym samym czasie. Aby ją włączyć, należy jednocześnie nacisnąć punkty 6, 7 i 8. Aktualnie praktycznie każda nowa funkcja, którą obsługiwać możemy za pomocą brajla, posiada osobne akordy umożliwiające jej wywołanie z poziomu brajlowskiej klawiatury.

Trzecią nowość stanowi możliwość użycia kursora podkreślenia, do wskazywania lokalizacji fokusa VoiceOver.

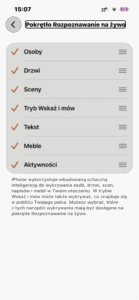

Czwarta to możliwość dostosowywania kombinacji punktów brajlowskich do najróżniejszych poleceń. Właśnie dlatego znajduje się ona w innej lokalizacji, tj. w zakładce Polecenia i nazywa się Wejście Braille’a z monitora i klawiatury. Możemy tam ustawiać akordy dla pisma Braille’a, nawigacji, działania VoiceOver i wielu innych akcji. Gdy zaczniecie je przeglądać, bardzo szybko zauważycie, że Apple dodało sporo nowych akordów brajlowskich. To piąta nowość w systemie iOS 26.

Szósta nazywa się Wejście Braille’a z klawiatury i podoba mi się najbardziej. Umożliwia pisanie brajlem z poziomu standardowej klawiatury. Jako klawiszy brajlowskich używamy bazowego rzędu klawiszy. Dzięki temu osoby, które nie są w stanie obsługiwać brajla na ekranie urządzenia i nie potrafią obsługiwać klasycznej klawiatury, będą mogły na niej pisać jak na fizycznej maszynie brajlowskiej. Co ciekawe, w ustawieniach Wejście Braille’a z monitora i klawiatury możemy wskazać konkretną klawiaturę zewnętrzną, która korzystać będzie z tej funkcji.

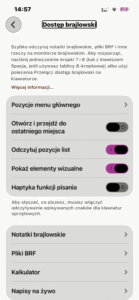

Rzeczą, która bardzo mocno mnie zaskoczyła, głównie dlatego, że na pierwszy rzut oka wygląda mocno abstrakcyjnie, jest siódma nowość, czyli pisanie jedną ręką brajlem na ekranie iUrządzenia. Jest to opcja dostępna tylko przy odblokowanej i pionowej orientacji ekranu.

Gdy włączymy Wejście Monitora Brajla, jak od teraz nazywa się pisanie brajlem, to po odblokowaniu orientacji ekranu i ustawieniu iPhone jak do rozmowy telefonicznej, VoiceOver wypowie komunikat: Orientacja pionowa, tryb jednoręczny. Wtedy należy jeszcze stuknąć dwukrotnie w ekran i przytrzymać trzema palcami, aby rozpocząć wprowadzanie kolumn kropek jedna po drugiej. Na pewno nie jest to szybkie, wygodne i ergonomiczne. Ale dla osoby niewidomej dysponującej jedną ręką może okazać się bardzo skutecznym rozwiązaniem.

Co więcej, możemy ten tryb konfigurować. I to nie tylko w zakresie na prawą i lewą rękę. Możemy również ustawić go w tryb Tabliczka i rysik, który doskonale znają osoby piszące kiedyś brajlem w tradycyjny sposób. Dostępny jest tryb klasycznej tabliczki oraz tabliczki odwróconej, czyli w negatywie.

Ósmą nowinkę stanowi rozszerzenie funkcji kalibrowania Wejścia Monitora Brajla. Dotychczas mogliśmy kalibrować ułożenie palców stukając w ekran. Na iPhone raz trzema palcami jednej, a potem trzema palcami drugiej ręki. Na iPadzie dwukrotnie wystukiwaliśmy sześciopunkt. Nadal mamy taką możliwość, ale teraz system dodatkowo uczy się ułożenia naszych palców. Oznacza to, że jeśli trzymamy telefon w jakiś niestandardowy sposób, to z czasem system nauczy się tego, jak układamy palce i nie będziemy musieli tak często kalibrować trybu Wejścia Monitora Brajla. Funkcję Ucz się położenia kropek. możemy oczywiście wyłączyć, a niezależnie od tego, dostępna jest także opcja zerowania tych ustawień, gdyby z urządzenia korzystało więcej osób.

Dziewiątą nowość stanowi nowa tablica Braille’a dla języka koreańskiego w układzie angielski bez kontrakcji).

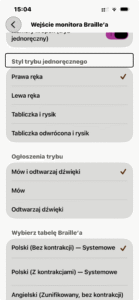

Rozpoznawanie VoiceOver

Następne nowości nie dotyczą już brajla. Znajdziemy je w sekcji Rozpoznawanie VoiceOver i zakładce Rozpoznawanie na żywo.

Funkcja Rozpoznawanie na żywo otrzymała nową opcję o nazwie Pokrętło Rozpoznawanie na żywo. Dzięki niej możemy wybrać jakie elementy Rozpoznawania będą dostępne na pokrętle. Do wyboru mamy obiekty pogrupowane w sekcje, takie jak Sceny, Osoby, Drzwi, Meble, Tekst oraz Tryb Wskaż i mów. Co ciekawe, dla każdego z nich możemy teraz osobno konfigurować sposoby anonsowania. Informację możemy otrzymywać w formie głosowej, prezentowanej w brajlu, dźwiękowej lub haptycznej. Przy czym działać mogą wszystkie jednocześnie, lub tylko te, które zaznaczymy.

Na uwagę zasługuje również fakt, że na pokrętle znajdziemy jeszcze jedną sekcję, której nie ma w ustawieniach, tj. Aktywności. Wygląda to na błąd i niekonsekwencję w interfejsie, co zapewne zostanie ujednolicone w kolejnych wersjach iOS 26.

Rozpoznawanie na żywo otrzymało jeszcze dwa nowe elementy. Czynności i Automatyczną latarkę.

Czynności umożliwiają stworzenie wielu konfiguracji opcji rozpoznawania, które najlepiej sprawdzają się w konkretnych sytuacjach. Innych ustawień użyjemy na sprawdzenie widoku za oknem, a innych dla odczytania komunikatu z ekranu ekspresu do kawy. Teraz zamiast każdorazowo przestawiać kilka parametrów, możemy od razu wybrać konkretną, przygotowaną zawczasu konfigurację.

Wcześniej mogliśmy tylko włączyć lub wyłączyć latarkę. Jednak osoby całkowicie niewidome nigdy nie miały pewności, kiedy jest już na tyle ciemno, aby już włączyć latarkę. Od iOS26 jeśli funkcja Rozpoznawanie na żywo samodzielnie określi, że jest zbyt ciemno, aby wykryć tekst, uruchomi latarkę na dziesięć, dwadzieścia i więcej sekund, w zależności od aktualnych potrzeb.

Szczegółowość

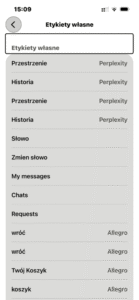

W kolejnej zakładce odnajdziemy następną nowość. Jest to opcja o nazwie Etykiety własne. Dzięki niej nareszcie możemy przejrzeć listę wszystkich stworzonych przez nas etykiet dla VoiceOver. Mocno się zdziwiłem, gdy się dowiedziałem, że zrobiłem ich już 575. Oczywiście nowa opcja umożliwia także wygodne usuwanie i edytowanie wszystkich dotychczas powstałych etykiet.

Następna nowość w tej zakładce nosi nazwę Sterowanie, Mów… Możemy wybrać aby role poszczególnych elementów, takich jak nagłówki, linki, przyciski itd. wymawiane były po lub przed elementem, albo żeby w ogóle nie były one anonsowane. Dla przykładu nagłówek określający wyszukiwarkę na stronie może być anonsowany jako: „Poziom nagłówka dwa, Wyszukiwarka”, „Wyszukiwarka, poziom nagłówka dwa” albo po prostu „Wyszukiwarka”.

Możliwość anonsowania Pozycji na liście dołączyła do grona oznajmianych elementów, stając się kolejną nowością w systemie iOS 26.

Dźwięk

W sekcji dźwięk tym razem pojawiła się tylko jedna nowość. Od iOS 26 możemy zaznaczyć, aby dźwięk nasłuchiwania przez Siri był zawsze odtwarzany. Aktualnie, w zależności od ustawień i uruchomionych aplikacji, nasłuchiwanie przez Siri może nie być anonsowane dźwiękiem. Warto to włączyć, jeśli nie mamy pewności czy Siri nas słyszy. Dzięki temu nie trzeba kilkukrotnie powtarzać tej samej komendy.

Polecenia

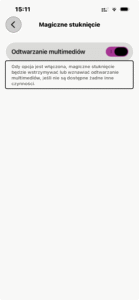

Zakładka Polecenia, poza wspomnianymi ustawieniami dla pisma brajla, zawiera jedną nowość. Są nią ustawienia dla Magicznego stuknięcia. Od tej pory gest podwójnego stuknięcia dwoma palcami możemy włączać i wyłączać dla funkcji odtwarzania.

Pokrętło

Sekcja Pokrętło otrzymała kilka drobnych usprawnień, które znajdziemy pod przyciskiem Rzeczy na Pokrętle. Przykładowo pozycja Głośność zmieniła nazwę na Głośność Mowy, a na listę elementów, które możemy umieścić na Pokrętle trafiły m.in.:

- Stopień łagodzenia dźwięku;

- Skopiowana mowa;

- Zoom (Braille);

- Grubość (Braille);

- Przesuwanie w poziomie (Braille);

- Przesuwanie w pionie (Braille);

- Odwrócenie (Braille).

Najbardziej podoba mi się pozycja Skopiowana mowa. Od tej pory możemy zarządzać ostatnio skopiowanymi frazami mówionymi i wybierać, które chcemy wkleić. Dzięki temu nie trzeba tak często przełączać się między oknami aplikacji, jeśli na przykład chcemy szybko wypełnić jakiś formularz skopiowanymi wcześniej informacjami.

Wpisywanie

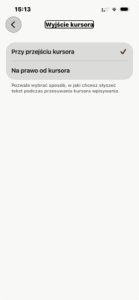

Sekcja Wpisywanie otrzymała jedną, drobną, za to dla wielu osób bardzo istotną nowość o nazwie Wyjście kursora. Dotychczasowe domyślne ustawienie wyglądało tak, że przy przechodzeniu znak po znaku, dany znak anonsowany był w momencie, gdy fokus VoiceOver go mijał. W efekcie, gdy doszliśmy do końca wyrazu i zaczynaliśmy wracać, ostatnia litera anonsowana była dwukrotnie. Aktualnie to ustawienie nazywa się – Przy przejściu kursora. Jeśli jednak wolimy, aby kursor zachowywał się w sposób zbliżony do tego znanego ze środowiska Windows, to możemy teraz zaznaczyć nową opcję – Na prawo od kursora. Włączyłem ją na chwilę, ale wygląda na to, że u mnie wygrywają przyzwyczajenia i dlatego dość szybko wróciłem do standardowego ustawienia.

Szybkie ustawienia

Do zakładki Szybkie ustawienia trafiło kilka nowych pozycji. Są to m.in.:

- Gesty wejścia monitora Braille’a;

- Rysuj ścieżkę, aby pisać;

- Rozpoznawanie ekranu.

Wyzeruj ustawienia VoiceOver

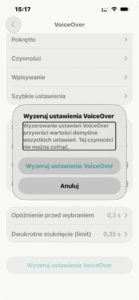

Ostatnia nowość dla czytnika ekranu znajduje się na samym końcu ustawień VO i nosi nazwę Wyzeruj ustawienia VoiceOver. Teraz, jeśli poprzestawiamy coś w opcjach czytnika, nie musimy już resetować całego iUrządzenia. Od iOS 26 jednym przyciskiem możemy wyzerować wszystkie ustawienia VoiceOver.

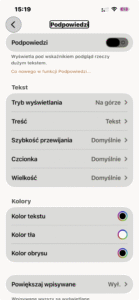

Podpowiedzi

Podpowiedzi to całkowicie nowa sekcja, która pojawiła się w głównych ustawieniach dostępności. Oferuje nam dwie nowości, stanowiące wsparcie dla osób słabowidzących.

Pierwsza polega na wyświetlaniu tekstowych podpowiedzi dla elementów, których użytkownik dotknie palcem na ekranie. Możemy ją konfigurować decydując, jakiej wielkości ma być wyświetlany tekst, jakiego koloru i na jakim tle.

Druga nazywa się Powiększaj wpisywane. Po jej aktywowaniu, aktualnie wpisywane słowa są automatycznie powiększane, tak aby użytkownik wyraźnie widział co i jak pisze.

Ekran i wielkość tekstu

Ustawienia dostępności dla ekranu otrzymały tylko jedną nowość, która na pewno ucieszy kierowców. Od iOS 26 CarPlay. otrzymało możliwość prezentowania informacji większą czcionką. Dotyczy to zarówno samego interfejsu, jak i treści prezentowanych w CarPlay..

Jestem bardzo zdziwiony, że Apple tak długo zwlekało z wprowadzeniem tej funkcji. Znam wielu kierowców, którzy nawet jeśli nie noszą osobnych okularów do jazdy samochodem, to używają okularów do czytania. Od tej pory nie będą musieli, ani zgadywać co jest na ekranie, ani na zbyt długo odrywać wzroku od jezdni, aby rozszyfrować komunikaty interfejsu.

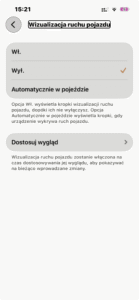

Ruch

A skoro mowa o pojazdach, to koniecznie muszę wspomnieć o nowości jaka trafiła do funkcji Wizualizacja ruchu pojazdu w zakładce Ruch.

Od iOS 26 osoby cierpiące na chorobę lokomocyjną mogą dostosowywać wygląd wizualizacji ruchu pojazdu, zmieniając kolor, wielkość, rozmieszczenie i zachowanie kropek prezentujących odczuwany ruch.

Domyślnie gdy jedziemy do przodu, kropki poruszają się w przód. Gdy pojazd skręca, kropki poruszają się w bok, w kierunku w którym skręcamy. A gdy pojazd zmienia prędkość, kropki poruszają się do przodu i do tyłu.

Czytaj i mów

Czytaj i mów to nowa nazwa starej sekcji Zawartość mówiona. Oprócz nowej nazwy, otrzymała ona także nową, niezwykle interesującą opcję o nazwie Lektor. Jego zadaniem jest ułatwienie odbioru treści tekstowych osobom z dysleksją, słabym wzrokiem czy innymi trudnościami w czytaniu.

Lektor umożliwia odczytanie lub odsłuchanie tekstu z dowolnej aplikacji, którą otworzymy na pełnym ekranie. Za jego pomocą możemy dostosować czcionki, układ i kolory tła do własnych preferencji. Później wystarczy stuknąć w przycisk Reader, aby treść widziana na ekranie została zaprezentowana zgodnie z naszymi preferencjami.

Nowa funkcja umożliwia nie tylko odczyt treści wbudowaną syntezą mowy po stuknięciu w przycisk, ale także takie ustawienie, aby Lektor rozpoczynał automatyczne czytanie w momencie, gdy włączymy tryb Readera. A jeśli czegoś nie usłyszymy przy automatycznym odczycie, u dołu ekranu znajdują się kontrolki sterowania odtwarzaczem, bardzo podobne do tych znanych z programów Voice Dream Reader czy Speech Central. Dzięki nim możemy wygodnie przewinąć odczytywaną treść i zapoznać się z nią ponownie.

Nową funkcją Lektora Apple rozszerzyło dziedziczenie styli, znane z przeglądarek internetowych, na cały system iOS oraz iPadOS sprawiając, że teraz każdy może zapoznawać się z treścią tekstową w taki sposób, jaki najbardziej mu odpowiada.

A jeśli jesteśmy przy odczytywaniu tekstu, to przyznam, że mocno zaskoczyło mnie zniknięcie z systemu iOS 26 opcji Mów Wpisywane, wraz z jej całym wachlarzem ustawień. Znam kilka osób słabowidzących, które chętnie z niej korzystały. Mam nadzieję, że albo ją przeoczyłem, albo że wróci do kolejnych wersji iOS 26.

Ruch i Motoryka

Ruch i Motoryka jest kolejną sekcją, która wraz z premierą iOS 26 otrzymała kilka nowości.

Pierwsze znajdziemy w zakładce Dotyk i funkcji AssistiveTouch. Od tej pory osoby mające problemy manualne mogą wpisywać tekst, rysując kursorem ścieżkę prowadzącą przez klawisze kolejnych liter klawiatury ekranowej. Rysuj ścieżkę, aby pisać jest funkcją, która początkowo została udostępniona osobom niewidomym, korzystającym z czytnika ekranu VoiceOver. Ewidentnie Apple dostrzegło potencjał tego rozwiązania i rozszerzyło je na inne technologie asystujące.

Kolejną nowość stanowi opcja o nazwie Czas zatrzymania klawiatury. Brzmi tajemniczo, ale co do zasady w działaniu przypomina ona tzw. lepkie klawisze. Jednak w tym wypadku dotyczy wirtualnej klawiatury. Jest to po prostu licznik czasu zatrzymania dla klawiszy klawiatury, który określa po jakim czasie przytrzymania dany klawisz powinien wywołać domyślną akcję.

Sterowanie przełącznikami

System iOS 26 nareszcie umożliwia tworzenie całych zestawów przełączników i wygodne przełączanie się między nimi. Sprawia to, że często wykonywane czy powtarzane operacje można łatwo automatyzować.

Zakładka Sterowanie przełącznikami otrzymała wspomnianą wcześniej funkcję Rysuj ścieżkę, aby pisać. Tyle, że teraz ścieżkę prowadzącą po ekranie przez klawisze kolejnych liter można poprowadzić za pomocą samych tylko przełączników.

Jeśli użytkownik oprócz przełączników korzysta także z opcji AssistiveTouch, to od iOS 26 może Szybko przełączać się między funkcjami Sterowanie przełącznikami i AssistiveTouch, wybierając AssistiveTouch w menu Sterowanie przełącznikami.

Wcześniej przełączniki w systemie iOS można było obsługiwać bezdotykowo jedynie gestami głowy. Od wersji 26 przełącznikami można sterować także za pomocą opcji śledzenia oczu.

A jeśli ktoś chce korzystać z przełączników sprzętowych to przypominam, że w ogóle nie trzeba posiadać dedykowanych, specjalistycznych przełączników sprzętowych. Mogą nimi być słuchawki AirPods, a nawet palce samego użytkownika, których stukanie palca wskazującego o kciuk zarejestruje kamera urządzenia.

Śledzenie oczu

Funkcja Śledzenie oczu oferuje teraz wskazówki i podpowiedzi wizualne dotyczące prawidłowego ustawienia głowy przed rozpoczęciem kalibracji śledzenia oczu. Dzięki takiej kalibracji, Śledzenie oczu działa znacznie lepiej.

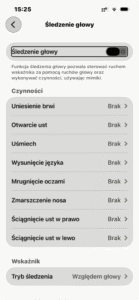

Śledzenie głowy

Oprócz śledzenia oczu, które dostępne było już od jakiegoś czasu w systemie iOS, w najnowszej wersji pojawiła się znana z systemu macOS funkcja Śledzenie głowy,. Ktoś może zauważyć, że jak to, przecież już wcześniej można było z niej korzystać do sterowania przełącznikami. I ten ktoś miałby rację. Jednak od iOS 26 Śledzenie głowy stanowi odrębny, całkowicie autonomiczny sposób sterowania urządzeniem mobilnym Apple. Pozwala teraz kierować ruchem wskaźnika za pomocą ruchów głowy oraz wykonywać różne czynności z użyciem mimiki twarzy.

Mówimy tu o takich gestach jak uniesienie brwi, otwarcie ust, uśmiech, wysunięcie języka, mrugnięcie oczami, zmarszczenie nosa, ściągnięcie ust w prawo lub w lewo. I zapewniam Was, że działa to fantastycznie. A skąd to wiem? Otóż dlatego, że ta funkcja dostępna jest od dłuższego czasu w systemach macOS. Kiedyś poprosiłem znajomego, aby zademonstrował jej działanie w praktyce. Film z tej demonstracji robi wrażenie dosłownie na każdym, kto go zobaczy. Dlatego Pawle, raz jeszcze dziękuję za ten pokaz. 🙂

Sterowanie głosowe

Funkcja głosowego sterowania w ramach nowości otrzymała więcej obsługiwanych języków, w tym arabski (Arabia Saudyjska), angielski (Singapur), włoski, koreański (Korea Południowa), rosyjski, turecki, kantoński (Chiny kontynentalne) i chiński (Tajwan). Polskiego oczywiście nadal nie ma.

iOS 26 wprowadza także obsługiwaną przez iCloud synchronizację między iUrządzeniami fraz tworzonych przez użytkownika.

Kolejną nowość stanowi możliwość wielokrotnego wykonywania poleceń głosowych. Działa to w ten sposób, że do polecenia dodajemy liczebnik. Dzięki temu możemy określić liczbę powtórzeń czynności przewijania, przenoszenia, przesuwania i panoramowania, na przykład, gdy powiemy „Przewiń w dół 3 razy”, to ekran zostanie automatycznie trzykrotnie przesunięty.

Funkcja otrzymała także cały zestaw nowych poleceń. Są to m.in.:

- Przesuń palcem od góry/dołu/lewej strony/prawej strony;

- Dodaj wiesz nad/pod;

- Pokaż/ukryj numery podczas edycji tekstu;

- Włącz/wyłącz śledzenie oczu;

- Włącz/wyłącz śledzenie głowy;

- Napisz do Siri.

RTT

W iOS 26 znajdziemy nową zakładkę RTT. We wcześniejszych systemach mogliśmy tę funkcję włączyć w ustawieniach Wiadomości i iMessage. Od teraz można ją osobno włączać dla każdego z aktywnych numerów iPhone.

Dźwięki wizualne

Znajdująca się w zakładce Dźwięki wizualne funkcja Dźwięki tła otrzymała możliwość zatrzymania odtwarzania nie tylko po zablokowaniu ekranu, ale także po określonym czasie odliczania. Co więcej, do dyspozycji mamy teraz korektor, gdzie wybierać możemy barwę i kontur dźwięków. Działa to całkiem fajnie. Jeśli jakieś dźwięki były dla nas na przykład zbyt ostre i wyraziste, możemy je teraz łatwo złagodzić.

Nareszcie funkcja Live Listen została wyciągnięta z ukrycia, czyli ustawień Centrum Sterowania i trafiła do sekcji Dźwięki wizualne. Do tej pory jej odnalezienie nastręczało sporych trudności.

Wraz z nową lokalizacją Live Listen otrzymało możliwość wyświetlania napisów podczas sesji Live Listen w czasie rzeczywistym.

Ciekawą nowością jest również możliwość nawigowania po tekście wyświetlanym na żywo. Jeśli czegoś nie zdążymy przeczytać, albo chcemy się upewnić, że dobrze odczytaliśmy np. jakąś nazwę, możemy przewinąć tekst do tyłu i to sprawdzić.

Doskonałym uzupełnieniem tej funkcji jest kolejna nowość, które umożliwia nam sterowanie sesją Live Listen, za pomocą pobliskich urządzeń Apple. Dzięki temu możemy używać na przykład Apple Watch, jako pilota zdalnego sterowania do rozpoczynania i zatrzymywania oraz przechodzenia do tyłu podczas sesji Live Listen.

W zakładce Dźwięki wizualne znajdziemy także inne nowości, nie tylko te związane z Live Listen. Jest ich całkiem sporo. Jedną z nich jest funkcja Zawsze pokazuj narzędzie głośności. Po jej włączeniu regulacja głośności jest zawsze widoczna na ekranie blokady. Zarówno dla słuchawek, jak i wbudowanego głośnika.

Kolejna, o nazwie Dodaj izolację głosu, wzmacnia słyszane dialogi. Pozwala osobom słabosłyszącym wyodrębnić dialogi z pośród słyszanych dźwięków. Głośność innych składników audio jest automatycznie obniżana. Zakładam jednak, że funkcja ta działać będzie tylko ze słuchawkami AirPods. Niestety nie mam słuchawek innych producentów, aby to sprawdzić.

Następna nowość, czyli Dodawaj dźwięk do połączeń, teoretycznie powinna działać dokładnie na odwrót. Po jej zaznaczeniu, aplikacje do komunikacji audio-video dołączają do sygnału audio wycinane wcześniej odgłosy otoczenia. Wyciszenie mikrofonu całkowicie i automatycznie wycisza wszystkie dźwięki połączenia. Piszę jednak teoretycznie, ponieważ sprawdzałem jej działanie i nie zauważyłem żadnej różnicy przy włączeniu lub wyłączeniu. Mogło więc być tak, że opcja ta nie działała w wersji beta, albo została nieprawidłowo opisana i po prostu nie rozumiem jej przeznaczenia.

Za to bardzo dobrze działa nowa funkcja w automatycznym odbieraniu audio połączeń. Od iOS 26 możemy określić, gdzie będzie kierowany dźwięk w czasie połączeń telefonicznych i FaceTime audio. Dzięki temu nie będziemy już zaskakiwani niespodziewanym przerzucaniem rozmowy na przykładowo zewnętrzne głośniki.

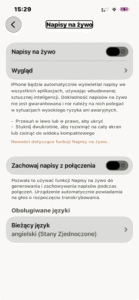

Napisy na żywo

Kolejną nową zakładką w ustawieniach dostępności jest pozycja Napisy na żywo. Dzięki niej od iOS 26 iPhone może automatycznie wyświetlać napisy we wszystkich aplikacjach, używając wbudowanej sztucznej inteligencji. Oczywiście ta nowość działa tylko tam, gdzie działa Apple Intelligence. Osobiście uważam, że jest to mocno testowe rozwiązanie. Szczególnie, że sam producent ostrzega, że dokładność napisów na żywo nie jest gwarantowana i nie należy na nich zawsze polegać. Co więcej, obecnie ta funkcja nie tylko nie obsługuje języka polskiego, ale także tylko kilka wybranych języków Siri.

Fajnym dodatkiem jest możliwość wygodnego wywoływania i chowania Napisów na żywo jednym gestem. Dodatkowo mogą być one prezentowane w widoku kompaktowym i pełnoekranowym, co nie tylko umożliwia dopasowanie do indywidualnych preferencji, ale także do wielkości okna.

Co ciekawe, funkcji tej można używać w trakcie rozmów telefonicznych. Jeśli ją uruchomimy, nasz rozmówca informowany jest głosowo o tworzeniu transkrypcji. Rozwiązanie to do złudzenia przypomina transkrypcję spotkań znaną z Microsoft Teams czy Zoom.

Użytkownik ma dostęp do transkrypcji z ostatnich 24 godzin. Może tworzyć z nich zrzuty ekranowe i nagrywać ekran, gdy są prezentowane. Może je przeglądać, kopiować i kasować.

Haptyka muzyki

Gdy opcja Haptyka muzyki pojawiła się w systemie iOS po raz pierwszy, wzbudziła ogromne zainteresowanie. Jednak użytkownikom brakowało możliwości jej konfigurowania. W wersji sygnowanej numerem 26, firma Apple wychodzi na przeciw tym oczekiwaniom.

Zakładka Dostosuj tryb haptyki umożliwia teraz włączenie wibracji pełnego utworu lub samych wokali.). Mnie bardziej podoba się pełen miks, ale właśnie o to chodzi, żeby każdy mógł wybrać coś dla siebie.

Z tego też powodu od iOS 26 możemy regulować Intensywność haptyki. Wibrację możemy ustawić na poziomie słabym, średnim lub mocnym.

Głos indywidualny

Co do zasady ta funkcja nie otrzymała żadnych nowości. Jednak zmieniony w niej został sposób tworzenia naszego indywidualnego głosu. Procedura została ujednolicona z tą, która już od jakiegoś czasu funkcjonuje w systemie macOS. Aktualnie syntezę naszego głosu możemy stworzyć szybciej i łatwiej, ponieważ do jej generowania wykorzystywane są krótsze fragmenty tekstu. Co ciekawe, coraz więcej aplikacji umożliwia wykorzystywanie w ten sposób utworzonego głosu. Należy do nich chociażby bardzo popularny wśród osób z wadami wzroku program Speech Central.

Dostęp wspomagany

Tryb Dostęp wspomagany w iOS 26 otrzymał całkiem sporo nowości.

Pierwszą stanowi możliwość wywoływania i wyłączania trybu jednym gestem. Dla łatwiejszego włączania funkcji przez osoby wspierające, tryb dostępu wspomaganego można teraz dodawać do skrótów dostępności. Dzięki temu zawsze będzie można go szybko uruchomić.

W niezoptymalizowanych aplikacjach można teraz ukryć przycisk Wróć. W takich programach jego rolę przejmie przycisk blokady ekranu.

Dostęp wspomagany otrzymał teraz możliwość odblokowywania iUrządzenia stuknięciem jednego palca w ekran. Co istotne, dotyczy to urządzeń, na których nie zarejestrowano Face ID ani Touch ID, a mimo to posiadają one ustawiony kod blokady.

Aktualnie można wybierać sposób wyświetlania ikon i tekstu w trybie Dostęp wspomagany. Opcja Wiersze zwiększa wielkość tekstu i wyświetla pozycje na listach, a opcja Siatka wyróżnia ikony.

Oprócz tego, do ustawień Dostępu wspomaganego trafiły opcje prezentowania treści na ekranie blokady, powiadomień, poziomu naładowania czy możliwość włączania i wyłączania wyciszenia urządzenia. Jest tego na tyle dużo, że bardzo dobrym posunięciem było umieszczenie na samym końcu menu przycisku, który umożliwia wyzerowanie konfiguracji opcji Dostęp wspomagany do ustawień fabrycznych.

Na koniec warto jeszcze zauważyć, że tryb Dostęp wspomagany działa teraz także w aplikacjach Apple TV oraz Zdjęcia.

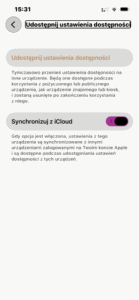

Udostępnij ustawienia dostępności

Ostatnią sekcją w głównych ustawieniach dostępności jest funkcja Udostępnij ustawienia dostępności. Dzięki niej od teraz możemy tymczasowo przenieść nasze ustawienia dostępności na inne urządzenie. Na przykład gdy chcemy komuś pomóc skonfigurować iPhone’a, lub chcemy skorzystać z jakiegoś publicznego urządzenia w rodzaju infokiosku. Po jej włączeniu tylko zbliżamy górną krawędź iPhone’a do innego urządzenia. Przenoszenie ustawień wygląda jak przesyłanie pliku przez AirDrop. Wystarczy zaakceptować transfer konfiguracji na nowym urządzeniu, aby po chwili mieć na nim aktywne te same opcje ułatwień dostępu, co na naszym podstawowym urządzeniu. UWAGA! Tymczasowe ustawienia nie są zapisywane na nowym urządzeniu. Działają tam tylko do momentu wyłączenia funkcji, dla której została pobrana konfiguracja. Na przykład czytnika VoiceOver.

Co ciekawe, jeśli zaznaczymy tę funkcję, to ustawienia z tego urządzenia będą dostępne także na innych naszych urządzeniach, na których jesteśmy zalogowani tym samym Apple ID. Teoretycznie oznacza to więc, że możemy udostępniać z poziomu jednego naszego iUrządzenia konfiguracje naszych pozostałych urządzeń. A pisze teoretycznie, ponieważ do testów dysponowałem tylko jednym iPhone z systemem w wersji 26.

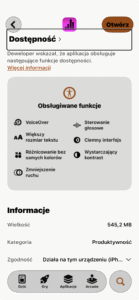

App Store

W iOS 26 nowości dostępnościowe pojawiły się także w innych miejscach systemu. Między innymi w sklepie z aplikacjami App Storę. Od teraz każda aplikacja posiada tzw. etykietę dostępności. Dowiemy się z niej, jeszcze przed pobraniem programu, jakie technologie asystujące on wspiera. Oczywiście musi upłynąć trochę czasu zanim wszyscy twórcy aplikacji dołączą do swych produktów odpowiednie etykiety, ale bardzo dużo programów już je posiada.

Podsumowanie

Analizując tegoroczne nowości dostępnościowe w iOS 26, często się dziwiłem. Z jednej strony zauważałem ustawienia, które znikały z opcji dostępności. Do ich grona trzeba jeszcze zaliczyć Sterowanie Aparatem, o którym wcześniej nie wspominałem. A z drugiej strony w ustawieniach brakuje wielu nowości, które Apple zapowiadało w trakcie WWDC oraz Światowego Dnia Świadomości Dostępności (ang. World Accessibility Awarenes Day). Można tu chociażby wymienić rozszerzenie działania funkcji Rozpoznawanie dźwięku o rozpoznawanie imienia użytkownika, dodanie wykrywania dźwięków ostrzegawczych w CarPlay, czy język hiszpański przy tworzeniu Głosu indywidualnego. Takie działanie jest dość nietypowe jak na Apple. Wydaje mi się, że odkąd relacjonuję nowości pojawiające się w systemach iOS, nie mieliśmy do czynienia z podobną sytuacją. A na pewno nie na taką skalę.

Gdy spróbowałem policzyć wszystkie zmiany, nowe funkcje i komendy wyszło mi, że powyżej zebrałem ponad 80 nowości dostępnościowych, które trafiły do systemu iOS 26. Oczywiście w systemie znajdują się jeszcze inne udogodnienia, o których nie wspomniałem, bo albo ich nie zauważyłem, albo jeszcze się nimi Apple nie pochwaliło. Taką nomen omen cichą nowością jest na przykład Haptyka przy odbieraniu połączeń. Dotychczas nawet nie zdawałem sobie sprawy, jak bardzo brakowało mi tej funkcji. Delikatne drżenie iPhone w momencie, gdy ktoś odbierze połączenie sprawia, że nie wołam po kilka razy do telefonu: Halo! Halo! Mała rzecz a cieszy. Takich małych udogodnień w nowym iOS jak zwykle pojawiło się kilka, ale także jak zwykle, część z nich pewnie odkryjemy dopiero po kilku miesiącach.

Powyższy tekst powstał na podstawie piątej publicznej wersji testowej systemu iOS 26. Jeśli więc w trakcie użytkowania oficjalnego wydania zauważycie jakieś inne nowości, o których tu nie wspomniałem, dajcie proszę znać, a ja uzupełnię ten wpis.

Piotr Witek